Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

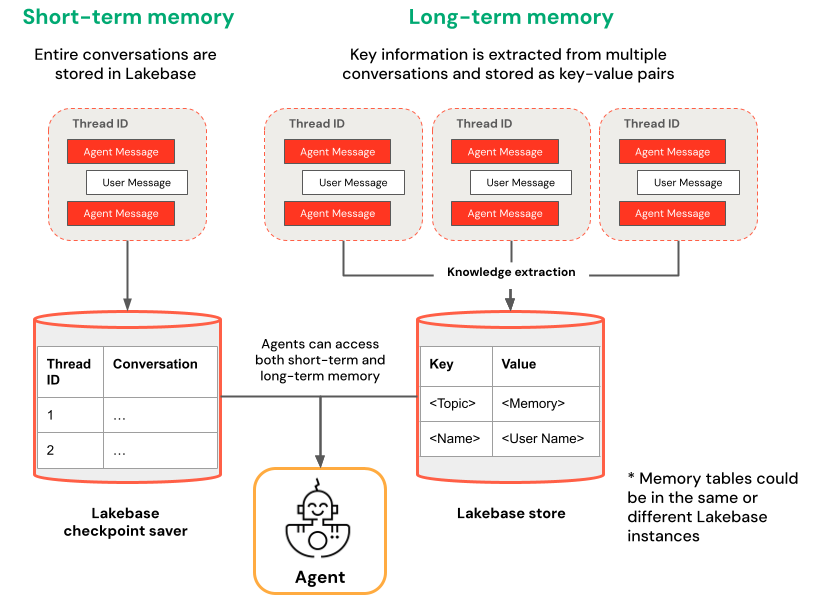

Gedächtnis ermöglicht es KI-Agenten, sich Informationen aus früheren Gesprächsverläufen oder vorangegangenen Unterhaltungen zu merken. Auf diese Weise können Agents kontextbezogene Antworten bereitstellen und personalisierte Erfahrungen im Laufe der Zeit erstellen. Verwenden Sie Databricks Lakebase, eine vollständig verwaltete Postgres OLTP-Datenbank, um den Konversationsstatus und -historie zu verwalten.

Anforderungen

- Aktivieren Sie Databricks-Apps in Ihrem Arbeitsbereich. Weitere Informationen finden Sie unter Einrichten ihres Databricks-Apps-Arbeitsbereichs und ihrer Entwicklungsumgebung.

- Eine Lakebase-Instanz finden Sie unter Erstellen und Verwalten einer Datenbankinstanz.

Kurzzeitgedächtnis vs. Langzeitgedächtnis

Kurzzeitspeicher erfasst Kontext in einer einzelnen Unterhaltungssitzung, während der Langzeitspeicher wichtige Informationen in mehreren Unterhaltungen extrahiert und speichert. Sie können Ihren Agenten mit einem der beiden Speichertypen oder mit beiden erstellen.

| Kurzzeitspeicher | Langzeitspeicher |

|---|---|

| Den Kontext in einer einzelnen Unterhaltungssitzung mithilfe von Thread-IDs und Checkpointing erfassen. Beibehalten des Kontexts für Folgefragen innerhalb einer Sitzung |

Automatisches Extrahieren und Speichern wichtiger Erkenntnisse in mehreren Sitzungen Personalisieren von Interaktionen basierend auf früheren Einstellungen Erstellen einer Wissensbasis zu Benutzern, die die Antworten im Laufe der Zeit verbessern |

Erste Schritte

Um einen Agent mit Speicher auf Databricks-Apps zu erstellen, klonen Sie eine vordefinierte App-Vorlage, und folgen Sie dem entwicklungsworkflow, der in Author an AI Agent beschrieben ist, und stellen Sie sie in Apps bereit. Die folgenden Vorlagen zeigen, wie mithilfe gängiger Frameworks Agenten kurzzeitiger und langfristiger Speicher hinzugefügt werden kann.

LangGraph

Klonen Sie die agent-langgraph-advanced-Vorlage , um einen LangGraph-Agent mit kurzfristigem und langfristigem Speicher zu erstellen. Die Vorlage verwendet den integrierten Checkpoint von LangGraph mit Lakebase für die dauerhafte Zustandsverwaltung, einschließlich threadbasierter Gesprächskontexte und beständiger Benutzereinblicke über Sitzungen hinweg.

git clone https://github.com/databricks/app-templates.git

cd app-templates/agent-langgraph-advanced

OpenAI Agents SDK

Klonen Sie die vorlage "agent-openai-advanced ", um einen Agent mit dem OpenAI Agents SDK mit kurzfristigem Speicher zu erstellen. Die Vorlage verwendet Lakebase für die dauerhafte Zustandsverwaltung, wodurch mehrteilige Gespräche mit automatischem Verlauf der Gesprächshistorie ermöglicht werden.

git clone https://github.com/databricks/app-templates.git

cd app-templates/agent-openai-advanced

Hintergrundausführung für lang laufende Agenten

Databricks Apps setzt eine HTTP-Verbindungs-Timeout von ca. 300 Sekunden. Mit der Hintergrundausführung können Agent-Aufgaben ausgeführt werden, die diesen Grenzwert überschreiten, nachdem die Verbindung geschlossen wurde. Der Client ruft Ergebnisse von einem separaten Endpunkt ab oder stellt eine Erneute Verbindung zum Fortsetzen des Streamings her.

Die erweiterten Vorlagen – agent-langgraph-advanced und agent-openai-advanced – erweitern die Basisvorlagen mit kurzzeitigem Speicher und lang laufender Hintergrundausführung über LongRunningAgentServerdatabricks-ai-bridge, wodurch Folgendes bereitgestellt wird:

-

Hintergrundmodus: Legen Sie

background=trueim Anforderungstext fest, um sofort eine Antwort-ID zurückzugeben und den Agent asynchron auszuführen. -

Endpunkt abrufen: Senden

GET /responses/{id}, um das Endergebnis abzurufen, oder um eine Streamingverbindung mit einer laufenden Ausführung zu öffnen. -

Resumable Streaming: Jedes servergesendete Ereignis enthält ein

sequence_number. Wenn die Verbindung abbricht, stellen Sie die Verbindung mitstarting_after=Nwieder her, um beim nächsten Ereignis fortzufahren. - TASK_TIMEOUT_SECONDS Umgebungsvariable, die die Dauer der Hintergrundaufgabe begrenzt. Dies ist unabhängig vom Http-Verbindungstimeout von 120 Sekunden Databricks Apps, das nur für eine einzelne HTTP-Anforderung gilt. (Standard: 1 Stunde)

Die erweiterte Vorlage README zeigt Anforderungsbeispiele für fünf Clientmodi:

- Invoke: Ein standardmäßiger, nicht-Streaming-POST.

- Stream: Ein standardmäßiger Streaming-POST.

-

Hintergrund, dann umfrage: POST mit

background=true, und dann abfragen, bis diesGET /responses/{id}abgeschlossen ist. -

Hintergrundstreaming, Fortsetzen über Stream: POST mit

background=trueundstream=true; wenn die Verbindung abbricht, erneut verbinden mitGET /responses/{id}undstream=true. -

Hintergrundstreaming, Fortsetzen über Abfrage: Gleicher Start; wenn die Verbindung abbricht, können Sie das Endergebnis abfragen

GET /responses/{id}.

Bereitstellen und Abfragen Ihres Agents

Nachdem Sie Ihren Agent mit Arbeitsspeicher konfiguriert haben, führen Sie die Schritte unter "Erstellen eines KI-Agents" aus, und stellen Sie ihn in Apps bereit , um Ihren Agent lokal auszuführen, zu bewerten und in Databricks-Apps bereitzustellen.