Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Gilt nur für:Foundry (klassisches) Portal. Dieser Artikel ist für das neue Foundry-Portal nicht verfügbar.

Erfahren Sie mehr über das neue Portal.

Hinweis

Links in diesem Artikel können Inhalte in der neuen Microsoft Foundry-Dokumentation anstelle der jetzt angezeigten Foundry-Dokumentation (klassisch) öffnen.

Wichtig

Azure OpenAI On Your Data ist veraltet und steht kurz vor dem Ruhestand.

Microsoft hat die Einführung neuer Modelle für Azure OpenAI On Your Data eingestellt. Diese Funktion unterstützt nur die folgenden Modelle:

- GPT-4o (Versionen 2024-05-13, 2024-08-06 und 20.11.2024)

- GPT-4o-mini (Version 18.07.2024) Sobald dieses Modell eingestellt wird funktionieren alle Azure OpenAI On Your Data API-Endpunkte und unterstützte Datenquellen-Connectoren nicht mehr.

Wir empfehlen, Azure OpenAI On Your Data Workloads zu Foundry Agent Service mit Foundry IQ zu migrieren, um Inhalte abzurufen und fundierte Antworten aus Ihren Daten zu generieren. Um zu starten, siehe Connect a Foundry IQ Knowledge Base.

Verwenden Sie diesen Artikel, um mehr über Azure OpenAI On Your Data zu erfahren, wodurch es entwicklern einfacher ist, ihre Unternehmensdaten schnell zu verbinden, aufzunehmen und zu integrieren, um personalisierte Copiloten (Vorschau) zu erstellen. Es verbessert das Verständnis der Benutzer, beschleunigt den Vorgangsabschluss, verbessert die betriebliche Effizienz und unterstützt entscheidungsfindung.

Was ist Azure OpenAI für Ihre Daten?

mit Azure OpenAI On Your Data können Sie erweiterte KI-Modelle wie GPT-35-Turbo und GPT-4 auf Ihren eigenen Unternehmensdaten ausführen, ohne Modelle trainieren oder optimieren zu müssen. Sie können mithilfe von Chat-Anwendungen Ihre Daten mit größerer Genauigkeit analysieren und bearbeiten. Sie können Quellen angeben, die die Antworten basierend auf den neuesten Informationen unterstützen, die in Ihren angegebenen Datenquellen verfügbar sind. Sie können über das SDK oder die webbasierte Schnittstelle im Microsoft Foundry Portal auf Azure OpenAI On Your Data zugreifen. Sie können auch eine Web-App erstellen, die eine Verbindung mit Ihren Daten herstellt, um eine erweiterte Chatlösung zu ermöglichen oder sie direkt als Copilot in der Copilot Studio (Vorschau) bereitzustellen.

Entwickeln mit Azure OpenAI auf Ihren Daten

In der Regel lautet der Entwicklungsprozess, den Sie mit Azure OpenAI On Your Data verwenden:

Einspeisung: Laden Sie Dateien entweder über das Foundry-Portal oder die Ingestions-API hoch. Auf diese Weise können Ihre Daten in eine Azure KI-Suche Instanz unterteilt und eingebettet werden, die von Azure OpenAI-Modellen verwendet werden kann. Wenn Sie über eine vorhandene unterstützte Datenquelle verfügen, können Sie sie auch direkt verbinden.

Develop: Nachdem Sie Azure OpenAI On Your Data versucht haben, beginnen Sie mit der Entwicklung Ihrer Anwendung mit der verfügbaren REST-API und SDKs, die in mehreren Sprachen verfügbar sind. Sie erstellt Eingabeaufforderungen und Suchabsichten, die an den Azure OpenAI-Dienst übergeben werden sollen.

Inference: Nachdem Ihre Anwendung in Ihrer bevorzugten Umgebung bereitgestellt wurde, sendet sie Aufforderungen an Azure OpenAI, die mehrere Schritte vor dem Zurückgeben einer Antwort ausführt:

Intent-Generierung: Der Dienst wird die Absicht der Benutzereingabe bestimmen, um eine angemessene Antwort zu ermitteln.

Abruf: Der Dienst ruft relevante Datenblöcke aus der verbundenen Datenquelle durch Abfragen ab. Beispiel: Verwenden einer semantischen oder Vektorsuche. Parameter wie Strenge und Anzahl der abzurufenden Dokumente werden verwendet, um den Abruf zu beeinflussen.

Filtration und Reranking: Suchergebnisse aus dem Abrufschritt werden durch Rangfolge und Filtern von Daten verbessert, um die Relevanz zu verfeinern.

Antwortgenerierung: Die resultierenden Daten werden zusammen mit anderen Informationen wie der Systemnachricht an das LLM (Large Language Model) übermittelt, und die Antwort wird an die Anwendung zurückgesendet.

Um zu beginnen, verbinden Sie Ihre Datenquelle über das Foundry-Portal , und beginnen Sie, Fragen zu stellen und mit Ihren Daten zu chatten.

Azure Rollenbasierte Zugriffssteuerungen (Azure RBAC) zum Hinzufügen von Datenquellen

Um Azure OpenAI Für Ihre Daten vollständig zu verwenden, müssen Sie eine oder mehrere Azure RBAC-Rollen festlegen. Weitere Informationen finden Sie unter Azure OpenAI On Your Data configuration.

Datenformate und Dateitypen

Azure OpenAI On Your Data unterstützt die folgenden Dateitypen:

.txt.md.html.docx.pptx.pdf

Es gibt ein Uploadlimit, und es gibt einige Hinweise zur Dokumentstruktur und wie sich dies auf die Qualität der Antworten aus dem Modell auswirken kann:

Wenn Sie Daten aus einem nicht unterstützten Format in ein unterstütztes Format konvertieren, optimieren Sie die Qualität der Modellantwort, indem Sie die Konvertierung sicherstellen:

- Führt nicht zu erheblichem Datenverlust.

- Fügt Ihren Daten kein unerwartetes Rauschen zu.

Wenn Ihre Dateien spezielle Formatierungen haben, z. B. Tabellen und Spalten oder Aufzählungszeichen, bereiten Sie Ihre Daten mit dem auf GitHub verfügbaren Datenvorbereitungsskript vor.

Für Dokumente und Datasets mit langer Text sollten Sie das verfügbare Datenvorbereitungsskript verwenden. Das Skript teilt die Daten in Abschnitte, damit die Antworten des Modells genauer sind. Dieses Skript unterstützt auch gescannte PDF-Dateien und -Bilder.

Unterstützte Datenquellen

Sie müssen eine Verbindung mit einer Datenquelle herstellen, um Ihre Daten hochzuladen. Wenn Sie Ihre Daten verwenden möchten, um mit einem Azure OpenAI-Modell zu chatten, werden Ihre Daten in einem Suchindex unterteilt, sodass relevante Daten basierend auf Benutzerabfragen gefunden werden können.

Hinweis

Ihre Daten sollten unstrukturierter Text sein, um optimale Ergebnisse zu erzielen. Wenn Sie über nicht textbezogene, halbstrukturierte oder strukturierte Daten verfügen, sollten Sie sie in Text konvertieren. Wenn Ihre Dateien spezielle Formatierungen haben, z. B. Tabellen und Spalten oder Aufzählungszeichen, bereiten Sie Ihre Daten mit dem auf GitHub verfügbaren Datenvorbereitungsskript vor.

Die Integrierte Vektordatenbank in vCore-basierten Azure Cosmos DB für MongoDB unterstützt nativ die Integration von Azure OpenAI On Your Data.

Für einige Datenquellen, z. B. das Hochladen von Dateien von Ihrem lokalen Computer (Vorschau) oder Daten, die in einem BLOB-Speicherkonto (Vorschau) enthalten sind, wird Azure KI-Suche verwendet. Wenn Sie die folgenden Datenquellen auswählen, werden Ihre Daten in einen Azure KI-Suche Index aufgenommen.

| Daten, die über Azure KI-Suche aufgenommen wurden | Beschreibung |

|---|---|

| Azure KI-Suche | Verwenden Sie einen vorhandenen Azure KI-Suche Index mit Azure OpenAI On Your Data. |

| Hochladen von Dateien (Vorschau) | Laden Sie Dateien von Ihrem lokalen Computer hoch, um in einer Azure Blob Storage-Datenbank gespeichert und in Azure KI-Suche aufgenommen zu werden. |

| URL/Webadresse (Vorschau) | Webinhalte aus den URLs werden in Azure Blob Storage gespeichert. |

| Azure Blob Storage (Vorschau) | Laden Sie Dateien aus Azure Blob Storage hoch, um in einen Azure KI-Suche Index aufgenommen zu werden. |

- Azure KI-Suche

- Vector-Datenbank in Azure Cosmos DB für MongoDB

- Azure Blob Storage (Vorschau)

- Hochladen von Dateien (Vorschau)

- URL/Webadresse (Vorschau)

- Elasticsearch (Vorschau)

- MongoDB Atlas (Vorschau)

Sie können die Verwendung eines Azure KI-Suche Index in Betracht ziehen, wenn Sie eine der folgenden Aktionen ausführen möchten:

- Passen Sie den Indexerstellungsprozess an.

- Verwenden Sie einen Index, der vor der Aufnahme von Daten aus anderen Datenquellen erstellt wurde.

Hinweis

- Um einen vorhandenen Index zu verwenden, muss es mindestens ein durchsuchbares Feld aufweisen.

- Legen Sie die CORS Allow Origin Type-Option auf

allund die Option "Zulässige Ursprünge " auf*. - In Ihrem Suchindex können keine komplexen Felder enthalten sein.

Suchtypen

Azure OpenAI On Your Data stellt die folgenden Suchtypen bereit, die Sie verwenden können, wenn Sie Ihre Datenquelle hinzufügen.

Vektorsuche mit dem

text-embedding-ada-002Einbettungsmodell , verfügbar in ausgewählten RegionenZum Aktivieren der Vektorsuche benötigen Sie ein vorhandenes Einbettungsmodell, das in Ihrer Azure OpenAI-Ressource bereitgestellt wird. Wählen Sie ihre Einbettungsbereitstellung aus, wenn Sie Ihre Daten verbinden, und wählen Sie dann einen der Vektorsuchtypen unter " Datenverwaltung" aus. Wenn Sie Azure KI-Suche als Datenquelle verwenden, stellen Sie sicher, dass Sie über eine Vektorspalte im Index verfügen.

Wenn Sie Ihren eigenen Index verwenden, können Sie die Feldzuordnung anpassen, wenn Sie Ihre Datenquelle hinzufügen, um die Felder zu definieren, die beim Beantworten von Fragen zugeordnet werden. Wählen Sie zum Anpassen der Feldzuordnung die Option "Benutzerdefinierte Feldzuordnung verwenden" auf der Seite " Datenquelle " aus, wenn Sie Die Datenquelle hinzufügen.

Wichtig

- Die semantische Suche unterliegt zusätzlichen Preisen. Sie müssen die Standard- oder höhere SKU auswählen, um die semantische Suche oder die Vektorsuche zu aktivieren. Weitere Informationen finden Sie unter Preisniveauunterschiede und Servicelimits .

- Um die Qualität des Abrufs von Informationen und der Modellantwort zu verbessern, empfehlen wir die Aktivierung der semantischen Suche für die folgenden Datenquellensprachen: Englisch, Französisch, Spanisch, Portugiesisch, Italienisch, Deutschland, Chinesisch (Zh), Japanisch, Koreanisch, Russisch und Arabisch.

| Suchoption | Abruftyp | Zusätzliche Preise? | Vorteile |

|---|---|---|---|

| Schlüsselwort | Stichwortsuche | Keine zusätzlichen Preise. | Führt schnelle und flexible Abfragen und Abgleichen über durchsuchbare Felder aus, wobei Begriffe oder Ausdrücke in jeder unterstützten Sprache mit oder ohne Operatoren verwendet werden. |

| semantisch | Semantische Suche | Zusätzliche Preise für die Verwendung der semantischen Suche . | Verbessert die Genauigkeit und Relevanz von Suchergebnissen mithilfe eines Rerankers (mit KI-Modellen), um die semantische Bedeutung von Abfragebegriffen und Dokumenten zu verstehen, die vom anfänglichen Suchbewertunger zurückgegeben werden. |

| Vektor | Vektorsuche | Weitere Preise auf Ihrem Azure OpenAI-Konto, indem Sie das Einbettungsmodell aufrufen. | Ermöglicht das Auffinden von Dokumenten, die einer bestimmten Abfrageeingabe auf der Grundlage der Vektoreinbettungen des Inhalts ähneln. |

| Hybrid (Vektor + Schlüsselwort) | Eine Hybridlösung von Vektorsuche und Stichwortsuche | Weitere Preise auf Ihrem Azure OpenAI-Konto, indem Sie das Einbettungsmodell aufrufen. | Führt die Ähnlichkeitssuche über Vektorfelder mithilfe von Vektoreinbettungen aus, unterstützt aber auch flexible Abfrageanalyse und Volltextsuche über alphanumerische Felder mithilfe von Ausdrucksabfragen. |

| Hybrid (Vektor + Schlüsselwort) + Semantik | Eine Hybridlösung der Vektorsuche, der semantischen Suche und der Stichwortsuche. | Zusätzliche Kosten auf Ihrem Azure OpenAI-Konto durch Aufrufen des Einbettungsmodells und zusätzliche Kosten für die Nutzung von semantische Suche. | Verwendet Vektoreinbettungen, Sprachverständnis und flexible Abfrageanalyse, um umfangreiche Suchfunktionen und generative KI-Apps zu erstellen, die komplexe und vielfältige Informationsabrufszenarien verarbeiten können. |

Intelligente Suche

Azure OpenAI On Your Data hat die intelligente Suche für Ihre Daten aktiviert. Die semantische Suche ist standardmäßig aktiviert, wenn Sie sowohl über die semantische Suche als auch über die Schlüsselwortsuche verfügen. Wenn Sie Modelle einbetten, wird die intelligente Suche standardmäßig für die Hybrid- und Semantiksuche verwendet.

Zugriffssteuerung auf Dokumentebene

Hinweis

Die Zugriffssteuerung auf Dokumentebene wird unterstützt, wenn Sie Azure KI-Suche als Datenquelle auswählen.

mit Azure OpenAI On Your Data können Sie die Dokumente einschränken, die in Antworten für unterschiedliche Benutzer mit Azure KI-Suche Sicherheitsfiltern verwendet werden können. Wenn Sie den Zugriff auf Dokumentenebene aktivieren, werden die von Azure KI-Suche zurückgegebenen Suchergebnisse basierend auf der Microsoft Entra-Gruppenmitgliedschaft des Benutzers gekürzt, um eine Antwort zu generieren. Sie können nur den Zugriff auf Dokumentebene für vorhandene Azure KI-Suche Indizes aktivieren. Weitere Informationen finden Sie unter Azure OpenAI On Your Data Network und Zugriffskonfiguration.

Indexfeldzuordnung

Wenn Sie Ihren eigenen Index verwenden, werden Sie im Foundry-Portal dazu aufgefordert, zu definieren, welche Felder Sie zur Beantwortung von Fragen zuordnen möchten, wenn Sie Ihre Datenquelle hinzufügen. Sie können mehrere Felder für Inhaltsdaten bereitstellen und alle Felder enthalten, die Text enthalten, der sich auf Ihren Anwendungsfall bezieht.

In diesem Beispiel stellen die Felder, die Inhaltsdaten und Titel zugeordnet sind, Informationen zum Modell bereit, um Fragen zu beantworten. Titel wird auch verwendet, um Zitattext zu betiteln. Das Feld, das dem Dateinamen zugeordnet ist, generiert die Zitatnamen in der Antwort.

Durch die korrekte Zuordnung dieser Felder wird sichergestellt, dass das Modell eine bessere Reaktions- und Zitatqualität aufweist. Sie können sie zusätzlich in der API mithilfe desfieldsMapping Parameters konfigurieren.

Suchfilter (API)

Wenn Sie zusätzliche wertbasierte Kriterien für die Abfrageausführung implementieren möchten, können Sie einen Suchfilter mithilfe des filter Parameters in der REST-API einrichten.

Wie Daten in Azure KI-Suche aufgenommen werden

Seit September 2024 wechselten die Aufnahme-APIs zu integrierter Vektorisierung. Durch dieses Update werden die vorhandenen API-Verträge nicht geändert. Integrierte Vektorisierung, ein neues Angebot von Azure KI-Suche, nutzt vorgefertigte Fähigkeiten zum Blöcken und Einbetten der Eingabedaten. Der Azure OpenAI On Your Data Ingestion-Service verwendet keine benutzerdefinierten Funktionen mehr. Nach der Migration zur integrierten Vektorisierung wurde der Aufnahmeprozess einige Änderungen durchlaufen, und daher werden nur die folgenden Ressourcen erstellt:

{job-id}-index-

{job-id}-indexer, wenn ein stündlicher oder täglicher Zeitplan angegeben ist, ansonsten erfolgt die Bereinigung des Indexierers am Ende des Ingestionsprozesses. {job-id}-datasource

Der Blockcontainer ist nicht mehr verfügbar, da diese Funktionalität nun von Azure KI-Suche verwaltet wird.

Datenverbindung

Sie müssen auswählen, wie Sie die Verbindung von Azure OpenAI, Azure KI-Suche und Azure BLOB-Speicher authentifizieren möchten. Sie können eine vom System zugewiesene verwaltete Identität oder einen API-Schlüssel auswählen. Wenn Sie API-Schlüssel als Authentifizierungstyp auswählen, füllt das System automatisch den API-Schlüssel auf, um eine Verbindung mit Ihren Azure KI-Suche, Azure OpenAI und Azure Blob Storage Ressourcen herzustellen. Durch Auswählen der vom System zugewiesenen verwalteten Identität basiert die Authentifizierung auf der Rollenzuweisung , die Sie haben. Die vom System zugewiesene verwaltete Identität ist standardmäßig für die Sicherheit ausgewählt.

Nachdem Sie die nächste Schaltfläche ausgewählt haben, wird Ihr Setup automatisch überprüft, um die ausgewählte Authentifizierungsmethode zu verwenden. Wenn ein Fehler auftritt, lesen Sie den Artikel "Rollenzuweisungen ", um Das Setup zu aktualisieren.

Nachdem Sie das Setup behoben haben, wählen Sie das nächste Mal aus, um zu überprüfen und fortzufahren. API-Benutzer können die Authentifizierung auch mit zugewiesenen verwalteten Identitäts- und API-Schlüsseln konfigurieren.

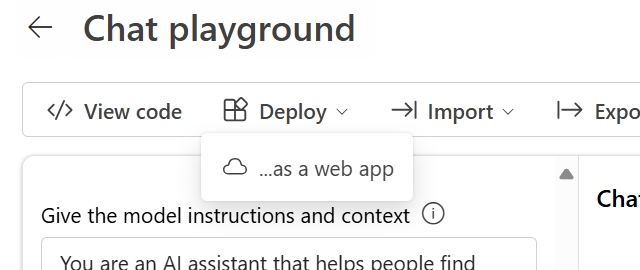

Bereitstellen für einen Copilot (Vorschau), eine Teams-App (Vorschau) oder eine Web-App

Nachdem Sie Azure OpenAI mit Ihren Daten verbunden haben, können Sie sie mithilfe der Schaltfläche Deploy to im Foundry-Portal bereitstellen.

Dadurch erhalten Sie mehrere Optionen für die Bereitstellung Ihrer Lösung.

Sie können einen Copilot in Copilot Studio (Vorschau) direkt vom Foundry Portal bereitstellen, sodass Sie Konversationserlebnisse über verschiedene Kanäle wie Microsoft Teams, Websites, Dynamics 365 und andere Azure Bot Service-Kanäle bringen können. Der in Azure OpenAI und im Copilot Studio (Vorschau) verwendete Mandant sollte derselbe sein. Weitere Informationen finden Sie unter Use a connection to Azure OpenAI On Your Data.

Hinweis

Die Bereitstellung eines Copilots in Copilot Studio (Vorschauversion) ist nur in US-amerikanischen Regionen verfügbar.

Konfigurieren Sie den Zugriff und das Netzwerk für Azure OpenAI in Ihren Daten.

Sie können Azure OpenAI On Your Data verwenden und Daten und Ressourcen mit Microsoft Entra ID rollenbasierten Zugriffssteuerung, virtuellen Netzwerken und privaten Endpunkten schützen. Sie können auch die Dokumente einschränken, die in Antworten für verschiedene Benutzer mit Azure KI-Suche Sicherheitsfiltern verwendet werden können. Sehen Sie Zugriff auf Ihre Daten in Azure OpenAI und Netzwerkkonfiguration.

Bewährte Methoden

In den folgenden Abschnitten erfahren Sie, wie Sie die Qualität der Antworten verbessern können, die vom Modell gegeben werden.

Ingestion-Parameter

Wenn Ihre Daten in Azure KI-Suche aufgenommen werden, können Sie die folgenden zusätzlichen Einstellungen entweder im Studio oder in ingestions-API ändern.

Blockgröße (Vorschau)

Azure OpenAI On Your Data verarbeitet Ihre Dokumente, indem es sie in Blöcke aufteilt, bevor sie aufgenommen werden. Die Blockgröße ist die maximale Größe in Bezug auf die Anzahl der Token eines beliebigen Blocks im Suchindex. Die Blockgröße und die Anzahl der abgerufenen Dokumente steuern, wie viele Informationen (Token) in der Aufforderung enthalten sind, die an das Modell gesendet wird. Im Allgemeinen ist die Blockgröße multipliziert mit der Anzahl der abgerufenen Dokumente die Gesamtanzahl der Token, die an das Modell gesendet werden.

Festlegen der Blockgröße für Ihren Anwendungsfall

Die Standardteilgröße beträgt 1.024 Token. Angesichts der Eindeutigkeit Ihrer Daten können Sie jedoch eine andere Blockgröße (z. B. 256, 512 oder 1.536 Token) effektiver finden.

Durch das Anpassen der Blockgröße kann die Leistung Ihres Chatbots verbessert werden. Während das Auffinden der optimalen Blockgröße einige Test- und Fehlerfehler erfordert, sollten Sie zunächst die Art Ihres Datasets berücksichtigen. Eine kleinere Blockgröße ist in der Regel besser für Datasets mit direkten Fakten und weniger Kontext, während eine größere Blockgröße für mehr kontextbezogene Informationen von Vorteil sein könnte, obwohl sie die Abrufleistung beeinträchtigen könnte.

Eine kleine Blockgröße wie 256 erzeugt präzisere Blöcke. Diese Größe bedeutet, dass das Modell auch weniger Token verwenden wird, um seine Ausgabe zu generieren, es sei denn, die Anzahl der abgerufenen Dokumente ist sehr hoch, und könnte dadurch weniger kosten. Kleinere Blöcke bedeuten auch, dass das Modell lange Textabschnitte nicht verarbeiten und interpretieren muss, wodurch Rauschen und Ablenkungen reduziert werden. Diese Granularität und der Fokus stellen jedoch ein potenzielles Problem dar. Wichtige Informationen gehören möglicherweise nicht zu den obersten abgerufenen Blöcken, insbesondere, wenn die Anzahl der abgerufenen Dokumente auf einen niedrigen Wert wie 3 festgelegt ist.

Tipp

Beachten Sie, dass das Ändern der Blockgröße erfordert, dass Ihre Dokumente erneut aufgenommen werden. Daher empfiehlt es sich, zuerst Laufzeitparameter wie Strenge und die Anzahl der abgerufenen Dokumente anzupassen. Erwägen Sie, die Blockgröße zu ändern, wenn Sie immer noch nicht die gewünschten Ergebnisse erhalten:

- Wenn Sie bei Fragen, deren Antworten in Ihren Dokumenten enthalten sein sollten, häufig Reaktionen wie „Ich weiß nicht“ erhalten, sollten Sie die Blockgröße auf 256 oder 512 reduzieren, um die Granularität zu verbessern.

- Wenn der Chatbot einige korrekte Details bereitstellt, aber andere fehlen, die in den Zitaten sichtbar werden, kann das Erhöhen der Blockgröße auf 1.536 dazu beitragen, weitere kontextbezogene Informationen zu erfassen.

Laufzeitparameter

Sie können die folgenden zusätzlichen Einstellungen im Abschnitt "Datenparameter " im Foundry-Portal und der API ändern. Sie müssen Ihre Daten nicht erneut aufnehmen, wenn Sie diese Parameter aktualisieren.

| Parametername | Beschreibung |

|---|---|

| Beschränken Sie Antworten auf Ihre Daten | Mit dieser Kennzeichnung wird der Ansatz des Chatbots für die Behandlung von Abfragen konfiguriert, die nicht mit der Datenquelle zusammenhängen oder wenn Suchdokumente für eine vollständige Antwort nicht ausreichen. Wenn diese Einstellung deaktiviert ist, ergänzt das Modell seine Antworten zusätzlich zu Ihren Dokumenten mit eigenen Kenntnissen. Wenn diese Einstellung aktiviert ist, versucht das Modell, sich nur auf Ihre Dokumente für Antworten zu verlassen. Dies ist der inScope Parameter in der API und wird standardmäßig auf "true" festgelegt. |

| Abgerufene Dokumente | Dieser Parameter ist eine ganze Zahl, die auf 3, 5, 10 oder 20 festgelegt werden kann, und steuert die Anzahl der Dokumentblöcke, die für das große Sprachmodell bereitgestellt werden, um die endgültige Antwort zu formatieren. Standardmäßig ist dies auf 5 festgelegt. Der Suchvorgang kann unübersichtlich sein, und manchmal kann aufgrund von Chunking relevante Information im Suchindex auf mehrere Segmente verteilt sein. Wenn Sie eine Top-K-Zahl, wie zum Beispiel 5, auswählen, wird sichergestellt, dass das Modell relevante Informationen extrahieren kann, trotz der inhärenten Einschränkungen bei der Suche und Segmentierung. Das Erhöhen der Zahl, die zu hoch ist, kann das Modell jedoch möglicherweise ablenken. Darüber hinaus hängt die maximale Anzahl von Dokumenten, die effektiv verwendet werden können, von der Version des Modells ab, da jede über eine andere Kontextgröße und Kapazität für die Verarbeitung von Dokumenten verfügt. Wenn Sie feststellen, dass Antworten wichtiger Kontext fehlt, versuchen Sie, diesen Parameter zu erhöhen. Dies ist der topNDocuments Parameter in der API und ist standardmäßig 5. |

| Striktheit | Bestimmt die Aggressivität des Systems beim Filtern von Suchdokumenten basierend auf ihren Ähnlichkeitsbewertungen. Das System fragt Azure Suche oder andere Dokumentspeicher ab und entscheidet dann, welche Dokumente für große Sprachmodelle wie ChatGPT bereitgestellt werden sollen. Das Filtern irrelevanter Dokumente kann die Leistung des End-to-End-Chatbots erheblich verbessern. Einige Dokumente werden von den Top-K-Ergebnissen ausgeschlossen, wenn sie niedrige Ähnlichkeitsbewertungen aufweisen, bevor sie an das Modell weitergeleitet werden. Dies wird durch einen ganzzahligen Wert von 1 bis 5 gesteuert. Das Festlegen dieses Werts auf 1 bedeutet, dass das System Dokumente basierend auf der Suchähnlichkeit der Benutzerabfrage minimal filtert. Umgekehrt weist eine Einstellung von 5 darauf hin, dass das System Dokumente aggressiv herausfiltert und dabei einen sehr hohen Ähnlichkeitsschwellenwert anwendet. Wenn Sie feststellen, dass der Chatbot relevante Informationen ausgelassen, verringern Sie die Strenge des Filters (legen Sie den Wert näher an 1 fest), um weitere Dokumente einzuschließen. Wenn irrelevante Dokumente dagegen die Antworten ablenken, erhöhen Sie den Schwellenwert (legen Sie den Wert näher auf 5 fest). Dies ist der strictness Parameter in der API und standardmäßig auf 3 festgelegt. |

Nicht zitierte Referenzen

Es ist möglich, dass das Modell "TYPE":"UNCITED_REFERENCE" anstelle von "TYPE":CONTENT in der API für Dokumente zurückgibt, die aus der Datenquelle abgerufen werden, aber nicht im Zitat enthalten sind. Dies kann beim Debuggen nützlich sein, und Sie können dieses Verhalten steuern, indem Sie die oben beschriebenen Laufzeitparameter für Strenge und abgerufene Dokumente ändern.

Systemnachricht

Sie können eine Systemnachricht definieren, um die Antwort des Modells zu steuern, wenn Sie Azure OpenAI On Your Data verwenden. Diese Nachricht ermöglicht Ihnen, Ihre Antworten auf Basis des Retrieval-augmented Generation (RAG)-Musters anzupassen, das Azure OpenAI On Your Data verwendet. Die Systemmeldung wird zusätzlich zu einer internen Basiseingabeaufforderung verwendet, um das Erlebnis bereitzustellen. Um dies zu unterstützen, wird die Systemnachricht nach einer bestimmten Anzahl von Token abgeschnitten, um sicherzustellen, dass das Modell Fragen mit Ihren Daten beantworten kann. Wenn Sie zusätzliches Verhalten über die Standardoberfläche definieren, stellen Sie sicher, dass Die Systemaufforderung detailliert ist und die genaue erwartete Anpassung erläutert.

Sobald Sie Ihr Dataset hinzugefügt haben, können Sie den Abschnitt Systemnachrichten im Foundry-Portal oder den role_informationParameter in der API verwenden.

Potenzielle Nutzungsmuster

Definieren einer Rolle

Sie können eine Rolle definieren, die Ihr Assistent einnehmen soll. Wenn Sie z. B. einen Support-Bot erstellen, können Sie hinzufügen: "Sie sind ein Experte im Bereich Vorfallsupport, der Benutzern hilft, neue Probleme zu lösen."

Definieren des Typs der abzurufenden Daten

Sie können auch die Art der Daten hinzufügen, die Sie dem Assistenten zur Verfügung stellen.

- Definieren Sie das Thema oder den Umfang Ihres Datasets, z. B. "Finanzbericht", "Akademisches Dokument" oder "Vorfallbericht". Beispielsweise können Sie für technischen Support "Sie beantworten Abfragen mithilfe von Informationen aus ähnlichen Vorfällen in den abgerufenen Dokumenten" hinzufügen.

- Wenn Ihre Daten bestimmte Merkmale aufweisen, können Sie diese Details zur Systemmeldung hinzufügen. Wenn Sich Ihre Dokumente beispielsweise in Japanisch befinden, können Sie "Sie japanische Dokumente abrufen und diese sorgfältig in Japanisch lesen und in Japanisch antworten" hinzufügen.

- Wenn Ihre Dokumente strukturierte Daten wie Tabellen aus einem Finanzbericht enthalten, können Sie diese Tatsache auch zur Systemaufforderung hinzufügen. Wenn Ihre Daten z. B. Tabellen enthalten, können Sie "Sie erhalten Daten in Form von Tabellen, die sich auf Finanzergebnisse beziehen, und Sie sollten die Tabellenzeile nach Zeile lesen, um Berechnungen durchzuführen, um Benutzerfragen zu beantworten."

Definieren des Ausgabestils

Sie können die Ausgabe des Modells auch ändern, indem Sie eine Systemmeldung definieren. Wenn Sie beispielsweise sicherstellen möchten, dass sich die Antworten des Assistenten auf Französisch befinden, können Sie eine Eingabeaufforderung wie "Sie sind ein KI-Assistent, der Benutzern hilft, Französische Informationen zu finden. Die Fragen des Benutzers können in Englisch oder Französisch sein. Bitte lesen Sie die abgerufenen Dokumente sorgfältig und beantworten Sie sie auf Französisch. Übersetzen Sie das Wissen aus Dokumenten ins Französische, um sicherzustellen, dass alle Antworten auf Französisch vorliegen."

Bekräftigen des kritischen Verhaltens

Azure OpenAI On Your Data funktioniert, indem Anweisungen an ein großes Sprachmodell in Form von Eingabeaufforderungen gesendet werden, um Benutzerabfragen mit Ihren Daten zu beantworten. Wenn für die Anwendung ein bestimmtes Verhalten wichtig ist, können Sie das Verhalten in der Systemmeldung wiederholen, um die Genauigkeit zu erhöhen. Um das Modell beispielsweise so zu leiten, dass es nur Fragen basierend auf Dokumenten beantwortet, können Sie "Bitte beantworten Sie nur mit abgerufenen Dokumenten und ohne Ihr eigenes Wissen zu nutzen. Generieren Sie für jede Behauptung in Ihrer Antwort Zitate aus den abgerufenen Dokumenten. Wenn die Frage des Benutzers nicht mit abgerufenen Dokumenten beantwortet werden kann, erläutern Sie bitte die Gründe, warum Dokumente für Benutzeranfragen relevant sind. Beantworten Sie in jedem Fall nicht mit Ihrem eigenen Wissen."

Hinweis

Die Systemmeldung wird verwendet, um zu ändern, wie der GPT-Assistent auf eine Benutzerfrage basierend auf der abgerufenen Dokumentation reagiert. Dies wirkt sich nicht auf den Abrufvorgang aus. Wenn Sie Anweisungen für den Abrufprozess bereitstellen möchten, empfiehlt es sich, sie in die Fragen aufzunehmen. Die Systemmeldung ist nur eine Anleitung. Das Modell hält sich möglicherweise nicht an jede angegebene Anweisung, da sie mit bestimmten Verhaltensweisen wie Objektivität und Vermeidung umstrittener Aussagen vorbereitet wurde. Unerwartetes Verhalten kann auftreten, wenn die Systemmeldung diesen Verhaltensweisen widerspricht.

Begrenzen Sie Antworten auf Ihre Daten

Diese Option empfiehlt das Modell, nur mit Ihren Daten zu reagieren und ist standardmäßig ausgewählt. Wenn Sie diese Option deaktivieren, kann das Modell seine internen Kenntnisse leichter anwenden, um zu reagieren. Ermitteln Sie die richtige Auswahl basierend auf Ihrem Anwendungsfall und Szenario.

Interagieren mit dem Modell

Verwenden Sie die folgenden Methoden, um optimale Ergebnisse beim Chatten mit dem Modell zu erzielen.

Aufgezeichnete Unterhaltungen

- Bevor Sie eine neue Unterhaltung starten (oder eine Frage stellen, die nicht mit den vorherigen verknüpft ist), löschen Sie den Chatverlauf.

- Es ist zu erwarten, dass unterschiedliche Antworten auf die gleiche Frage zwischen der ersten Gesprächsrunde und den folgenden gegeben werden, da der Gesprächsverlauf den aktuellen Zustand des Modells ändert. Wenn Sie falsche Antworten erhalten, melden Sie sie als Qualitätsfehler.

Modellantwort

Wenn Sie mit der Modellantwort für eine bestimmte Frage nicht zufrieden sind, versuchen Sie entweder, die Frage spezifischer oder allgemeiner zu machen, um zu sehen, wie das Modell antwortet, und stellen Sie Ihre Frage entsprechend um.

Denkanstoß hat sich als wirksam erwiesen, um das Modell zu ermutigen, die gewünschten Ausgaben für komplexe Fragen/Aufgaben zu erzeugen.

Fragelänge

Vermeiden Sie es, lange Fragen zu stellen, und unterteilen Sie sie nach Möglichkeit in mehrere Fragen. Die GPT-Modelle haben Grenzwerte für die Anzahl der Token, die sie akzeptieren können. Tokengrenzwerte werden berücksichtigt bei: der Benutzerfrage, der Systemnachricht, den abgerufenen Suchdokumenten (Blöcke), internen Eingabeaufforderungen, dem Gesprächsverlauf (falls vorhanden) und der Antwort. Wenn die Frage den Tokengrenzwert überschreitet, wird sie abgeschnitten.

Mehrsprachige Unterstützung

Derzeit unterstützen die Schlüsselwortsuche und die semantische Suche in Azure OpenAI On Your Data Abfragen in derselben Sprache wie die Daten im Index. Wenn sich Ihre Daten beispielsweise in Japanisch befindet, müssen eingabeabfragen auch japanisch sein. Für den mehrsprachigen Dokumentabruf wird empfohlen, den Index mit aktivierter Vektorsuche zu erstellen.

Um die Qualität der Informationsempfangs- und Modellantwort zu verbessern, empfehlen wir die Aktivierung der semantischen Suche für die folgenden Sprachen: Englisch, Französisch, Spanisch, Portugiesisch, Italienisch, Deutschland, Chinesisch (Zh), Japanisch, Koreanisch, Russisch, Arabisch

Wir empfehlen die Verwendung einer Systemmeldung, um das Modell darüber zu informieren, dass sich Ihre Daten in einer anderen Sprache befindet. Zum Beispiel:

*"*Sie sind ein KI-Assistent, der Benutzern dabei hilft, Informationen aus abgerufenen japanischen Dokumenten zu extrahieren. Bitte überprüfen Sie die japanischen Dokumente sorgfältig, bevor Sie eine Antwort formulieren. Die Abfrage des Benutzers befindet sich in Japanisch, und Sie müssen auch auf Japanisch antworten."

Wenn Sie Dokumente in mehreren Sprachen haben, empfehlen wir, einen neuen Index für jede Sprache zu erstellen und separat mit Azure OpenAI zu verbinden.

Streamen von Daten

Sie können eine Streaminganforderung mithilfe des stream Parameters senden, sodass Daten inkrementell gesendet und empfangen werden können, ohne auf die gesamte API-Antwort zu warten. Dies kann die Leistung und die Benutzererfahrung verbessern, insbesondere für große oder dynamische Daten.

{

"stream": true,

"data_sources": [

{

"type": "AzureCognitiveSearch",

"parameters": {

"endpoint": "'$AZURE_AI_SEARCH_ENDPOINT'",

"key": "'$AZURE_AI_SEARCH_API_KEY'",

"indexName": "'$AZURE_AI_SEARCH_INDEX'"

}

}

],

"messages": [

{

"role": "user",

"content": "What are the differences between Azure Machine Learning and Foundry Tools?"

}

]

}

Konversationsverlauf für bessere Ergebnisse

Wenn Sie mit einem Modell chatten, kann die Bereitstellung einer Chat-Historie dem Modell helfen, qualitativ hochwertigere Ergebnisse zu liefern. Sie müssen die context Eigenschaft der Assistentennachrichten nicht in Ihre API-Anforderungen einschließen, um eine bessere Antwortqualität zu erzielen. Beispiele finden Sie in der API-Referenzdokumentation .

Funktionsaufrufe

In einigen Azure OpenAI-Modellen können Sie tools und tool_choice Parameter definieren zum Aktivieren von Funktionsaufrufen. Sie können Funktionsaufrufe über die REST-API/chat/completions einrichten. Wenn sich beide toolsDatenquellen in der Anforderung befinden, wird die folgende Richtlinie angewendet.

- Wenn

tool_choicewahrnoneist, werden die Tools ignoriert, und nur die Datenquellen werden verwendet, um die Antwort zu generieren. - Andernfalls, wenn

tool_choicenicht angegeben ist oder wenn es alsautooder als Objekt angegeben ist, werden die Datenquellen ignoriert, und die Antwort enthält ggf. den Namen der ausgewählten Funktion und die Argumente. Selbst wenn das Modell entscheidet, dass keine Funktion ausgewählt wird, werden die Datenquellen weiterhin ignoriert.

Wenn die oben genannte Richtlinie Ihre Anforderungen nicht erfüllt, ziehen Sie weitere Optionen in Betracht, z. B.: Aufforderungsfluss oder Assistenten-API.

Tokenverwendungsschätzung für Azure OpenAI basierend auf Ihren Daten

Azure OpenAI On Your Data Retrieval Augmented Generation (RAG) ist ein Dienst, der sowohl einen Suchdienst (wie Azure KI-Suche) als auch die Generation (Azure OpenAI-Modelle) nutzt, um Benutzern Antworten auf ihre Fragen basierend auf bereitgestellten Daten zu ermöglichen.

Im Rahmen dieser RAG-Pipeline gibt es drei Schritte auf hoher Ebene:

Reformieren sie die Benutzerabfrage in eine Liste der Suchabsichten. Dazu rufen Sie das Modell mit einer Eingabeaufforderung auf, die Anweisungen, die Frage des Benutzers und den Unterhaltungsverlauf enthält. Nennen wir dies eine Absichtsaufforderung.

Für jeden Zweck werden mehrere Dokumentblöcke aus dem Suchdienst abgerufen. Nach dem Filtern irrelevanter Blöcke basierend auf dem vom Benutzer angegebenen Schwellenwert der Strenge und dem Reranking/Aggregating der Blöcke basierend auf der internen Logik werden die vom Benutzer angegebenen Anzahl von Dokumentblöcken ausgewählt.

Diese Dokumentblöcke werden zusammen mit der Benutzerfrage, dem Unterhaltungsverlauf, Rolleninformationen und Anweisungen an das Modell gesendet, um die endgültige Modellantwort zu generieren. Nennen wir diese Aufforderung zur Generierung.

Insgesamt gibt es zwei Aufrufe an das Modell:

Zur Verarbeitung der Absicht: Die Tokenschätzung für die Absichtsaufforderung umfasst diejenigen für die Benutzerfrage, den Unterhaltungsverlauf und die Anweisungen, die an das Modell für die Absichtsgenerierung gesendet wurden.

Zum Generieren der Antwort: Die Tokenschätzung für die Generierungsaufforderung enthält diejenigen für die Benutzerfrage, den Unterhaltungsverlauf, die abgerufene Liste der Dokumentabschnitte, Rolleninformationen und die Anweisungen, die für die Generierung an sie gesendet werden.

Das Modell generierte Ausgabetoken (sowohl Absichten als auch Antworten) sollten bei der Berechnung der Gesamttoken berücksichtigt werden. Durch das Addieren aller vier nachfolgenden Spalten erhalten Sie die durchschnittlichen Gesamttoken, die zum Generieren einer Antwort verwendet werden.

| Modell | Anzahl der Generierungsaufforderungstoken | Anzahl der Intent-Prompt-Token | Anzahl des Antworttokens | Anzahl der Intent-Tokens |

|---|---|---|---|---|

| gpt-35-turbo-16k | 4297 | 1366 | 111 | 25 |

| gpt-4-0613 | 3997 | 1385 | 118 | 18 |

| gpt-4-1106-preview | 4538 | 811 | 119 | 27 |

| gpt-35-turbo-1106 | 4854 | 1372 | 110 | 26 |

Die obigen Zahlen basieren auf dem Testen eines Datasets mit:

- 191 Unterhaltungen

- 250 Fragen

- 10 durchschnittliche Token pro Frage

- 4 Gesprächsrunden pro Gespräch im Durchschnitt

Und die folgenden Parameter.

| Konfiguration | Wert |

|---|---|

| Anzahl der abgerufenen Dokumente | 5 |

| Striktheit | 3 |

| Blockgröße | 1024 |

| Antworten auf aufgenommene Daten einschränken? | WAHR |

Diese Schätzungen variieren je nach den für die obigen Parameter festgelegten Werten. Wenn beispielsweise die Anzahl der abgerufenen Dokumente auf 10 festgelegt ist und die Strenge auf 1 festgelegt ist, wird die Tokenanzahl nach oben verschoben. Wenn zurückgegebene Antworten nicht auf die aufgenommenen Daten beschränkt sind, gibt es weniger Anweisungen für das Modell, und die Anzahl der Token geht nach unten.

Die Schätzungen hängen auch von der Art der gestellten Dokumente und Fragen ab. Wenn die Fragen beispielsweise offen sind, sind die Antworten wahrscheinlich länger. Ebenso wird eine längere Systemnachricht dazu führen, dass die Eingabeaufforderung länger wird und mehr Token verbraucht. Wenn zudem der Unterhaltungsverlauf lang ist, verlängert sich die Eingabeaufforderung entsprechend.

| Modell | Maximale Token für Systemnachricht |

|---|---|

| GPT-35-0301 | 400 |

| GPT-35-0613-16K | 1000 |

| GPT-4-0613-8K | 400 |

| GPT-4-0613-32K | 2000 |

| GPT-35-turbo-0125 | 2000 |

| GPT-4-Turbo-0409 | 4000 |

| GPT-4o | 4000 |

| GPT-4o-mini | 4000 |

Die obige Tabelle zeigt die maximale Anzahl von Token, die für die Systemmeldung verwendet werden können. Informationen zum Anzeigen der maximalen Token für die Modellantwort finden Sie im Artikel "Modelle". Darüber hinaus werden von den folgenden auch Tokens verbraucht:

Die Metaaufforderung: Wenn Sie Antworten vom Modell auf den Erdungsdateninhalt (

inScope=Truein der API) beschränken, ist die maximale Anzahl von Token höher. Andernfalls (z. B. wenninScope=False) das Maximum niedriger ist. Diese Zahl ist variabel und hängt von der Tokenlänge der Benutzerfrage und dem Verlauf der Unterhaltung ab. Diese Schätzung umfasst die Basisaufforderung und die Abfrageumschreibungsaufforderungen für den Abruf.Benutzerfrage und Verlauf: Variabel, aber auf 2.000 Token begrenzt.

Abgerufene Dokumente (Blöcke): Die Anzahl der von den abgerufenen Dokumentblöcken verwendeten Token hängt von mehreren Faktoren ab. Die obere Grenze hierfür ist die Anzahl der abgerufenen Dokumentblöcke, die mit der Blockgröße multipliziert werden. Sie wird jedoch basierend auf den verfügbaren Token für das spezifische Modell, das nach der Zählung der restlichen Felder verwendet wird, abgeschnitten.

20% der verfügbaren Token sind für die Modellantwort reserviert. Die verbleibenden 80% verfügbarer Token umfassen die Metaaufforderung, die Benutzerfrage und den Unterhaltungsverlauf sowie die Systemnachricht. Das verbleibende Tokenbudget wird von den abgerufenen Dokumentblöcken verwendet.

Verwenden Sie das folgende Codebeispiel, um die Anzahl der von Ihrer Eingabe verbrauchten Token (z. B. Ihre Frage, die Systemnachricht/Rolleninformationen) zu berechnen.

import tiktoken

class TokenEstimator(object):

GPT2_TOKENIZER = tiktoken.get_encoding("gpt2")

def estimate_tokens(self, text: str) -> int:

return len(self.GPT2_TOKENIZER.encode(text))

token_output = TokenEstimator.estimate_tokens(input_text)

Problembehandlung

Um fehlgeschlagene Vorgänge zu beheben, achten Sie immer auf Fehler oder Warnungen, die entweder im API-Antwort- oder Foundry-Portal angegeben sind. Hier sind einige der häufigsten Fehler und Warnungen:

Fehlgeschlagene Ingestionsaufgaben

Probleme mit Kontingentbeschränkungen

Ein Index mit dem Namen X im Dienst Y konnte nicht erstellt werden. Das Indexkontingent wurde für diesen Dienst überschritten. Sie müssen entweder zuerst nicht verwendete Indizes löschen, eine Verzögerung zwischen Indexerstellungsanforderungen hinzufügen oder den Dienst auf höhere Grenzwerte aktualisieren.

Das Standardindexerkontingent von X wurde für diesen Dienst überschritten. Zurzeit verfügen Sie über X-Standardindexer. Sie müssen entweder zuerst nicht verwendete Indexer löschen, den Indexer "executionMode" ändern oder den Dienst für höhere Grenzwerte aktualisieren.

Auflösung:

Führen Sie ein Upgrade auf ein höheres Preisniveau aus, oder löschen Sie nicht verwendete Ressourcen.

Timeoutprobleme bei der Vorverarbeitung

Die Fähigkeit konnte nicht ausgeführt werden, da die Web-API-Anforderung fehlgeschlagen ist.

Fähigkeit konnte nicht ausgeführt werden, da die Web-API-Fähigkeitsantwort ungültig ist.

Auflösung:

Unterteilen Sie die Eingabedokumente in kleinere Dokumente, und versuchen Sie es erneut.

Berechtigungsprobleme

Diese Anforderung ist nicht zum Ausführen dieses Vorgangs autorisiert.

Auflösung:

Dies bedeutet, dass auf das Speicherkonto nicht mit den angegebenen Anmeldeinformationen zugegriffen werden kann. Überprüfen Sie in diesem Fall die an die API übergebenen Speicherkontoanmeldeinformationen, und stellen Sie sicher, dass das Speicherkonto nicht hinter einem privaten Endpunkt verborgen ist (wenn ein privater Endpunkt nicht für diese Ressource konfiguriert ist).

503 Fehler beim Senden von Abfragen mit Azure KI-Suche

Jede Benutzernachricht kann in mehrere Suchabfragen übersetzt werden, die alle parallel an die Suchressource gesendet werden. Dies kann zu einem Drosselungsverhalten führen, wenn die Anzahl der Suchreplikate und Partitionen gering ist. Die maximale Anzahl von Abfragen pro Sekunde, die eine einzelne Partition und ein einzelnes Replikat unterstützen können, reicht möglicherweise nicht aus. Erwägen Sie in diesem Fall, Ihre Replikas und Partitionen zu erhöhen, oder überlegen Sie, in Ihrer Anwendung eine Warte-/Wiederholungslogik hinzuzufügen. Weitere Informationen finden Sie in der dokumentation Azure KI-Suche.

Regionale Verfügbarkeit und Modellunterstützung

Wichtig

Azure OpenAI On Your Data ist veraltet und steht kurz vor dem Ruhestand.

Microsoft hat die Einführung neuer Modelle für Azure OpenAI On Your Data eingestellt. Diese Funktion unterstützt nur die folgenden Modelle:

- GPT-4o (Versionen 2024-05-13, 2024-08-06 und 20.11.2024)

- GPT-4o-mini (Version 18.07.2024) Sobald dieses Modell eingestellt wird funktionieren alle Azure OpenAI On Your Data API-Endpunkte und unterstützte Datenquellen-Connectoren nicht mehr.

Wir empfehlen, Azure OpenAI On Your Data Workloads zu Foundry Agent Service mit Foundry IQ zu migrieren, um Inhalte abzurufen und fundierte Antworten aus Ihren Daten zu generieren. Um zu starten, siehe Connect a Foundry IQ Knowledge Base.

Informationen zur regionalen Verfügbarkeit finden Sie in der Modellzusammenfassungstabelle .