Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Wenn Datenflüsse in Senken schreiben, erfolgt jede benutzerdefinierte Partitionierung unmittelbar vor dem Schreiben. Wie auch bei der Quelle, ist es in den meisten Fällen zu empfehlen, die Auswahl der Partitionierungsoption Aktuelle Partitionierung verwenden beizubehalten. Partitionierte Daten schreiben viel schneller als nicht partitionierte Daten, sogar Ihr Ziel wird nicht partitioniert. Im Folgenden finden Sie die individuellen Überlegungen für verschiedene Senkentypen.

Azure SQL-Datenbank-Senken

Bei Azure SQL-Datenbank sollte die Standardpartitionierung in den meisten Fällen funktionieren. Es besteht die Möglichkeit, dass Ihre Senke über zu viele Partitionen verfügt, sodass sie von Ihrer SQL-Datenbank-Instanz nicht mehr verarbeitet werden können. Reduzieren Sie in diesem Fall die Anzahl von Partitionen, die von Ihrer SQL-Datenbank-Senke ausgegeben werden.

Bewährtes Verfahren zum Löschen von Zeilen in der Senke aufgrund fehlender Zeilen in der Quelle

In diesem Video wird gezeigt, wie Datenflüsse mit Exists-, Zeilenänderungs- und Senkentransformationen verwendet werden können, um dieses allgemeine Muster zu erreichen:

Auswirkungen der Fehlerzeilenbehandlung auf die Leistung

Wenn Sie die Fehlerzeilenbehandlung ("bei Fehler fortfahren") in der Sinktransformation aktivieren, führt der Dienst einen zusätzlichen Schritt aus, bevor die kompatiblen Zeilen in Ihre Zieltabelle geschrieben werden. Dieser zusätzliche Schritt führt zu einer geringen Leistungseinbuße, die für diesen Schritt mit etwa 5 % veranschlagt werden kann. Eine zusätzliche kleine Leistungseinbuße tritt auf, wenn Sie auch die Option zum Schreiben inkompatibler Zeilen für eine Protokolldatei festlegen.

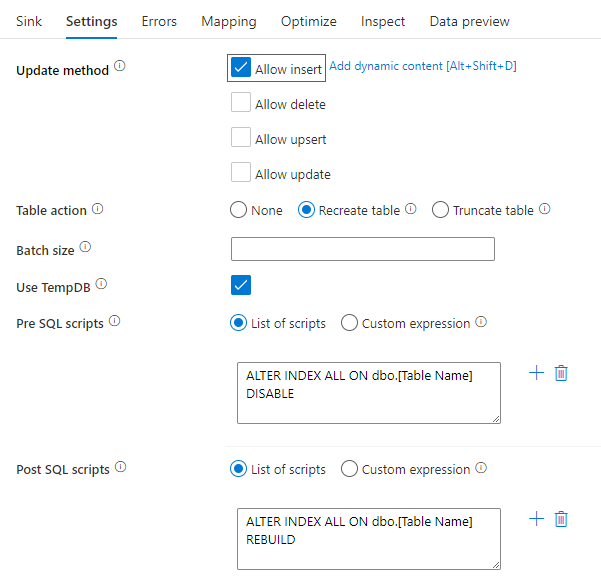

Deaktivieren von Indizes mithilfe eines SQL-Skripts

Durch das Deaktivieren von Indizes vor dem Laden in einer SQL-Datenbank kann die Leistung des Schreibens in die Tabelle erheblich verbessert werden. Führen Sie den folgenden Befehl aus, bevor Sie in die SQL-Spüle schreiben.

ALTER INDEX ALL ON dbo.[Table Name] DISABLE

Nachdem der Schreibvorgang abgeschlossen wurde, erstellen Sie die Indizes mit dem folgenden Befehl neu:

ALTER INDEX ALL ON dbo.[Table Name] REBUILD

Dies kann sowohl nativ mit Pre- und Post-SQL-Skripts auf einer Azure SQL-Datenbank-Instanz als auch über eine Synapse-Senke in Zuordnungsdatenflüssen durchgeführt werden.

Warnung

Wenn Indizes deaktiviert werden, übernimmt der Datenfluss effektiv die Kontrolle über eine Datenbank, und Abfragen sind zu diesem Zeitpunkt nicht erfolgreich. Daher werden viele ETL-Aufträge mitten in der Nacht ausgelöst, um diesen Konflikt zu vermeiden. Weitere Informationen finden Sie unter den Einschränkungen zum Deaktivieren von SQL-Indizes.

Skalieren der Datenbank

Planen Sie die Anpassung der Größe Ihrer Quelle und Senke in Azure SQL-Datenbank und Azure SQL Data Warehouse vor der Pipelineausführung, um den Durchsatz zu erhöhen und die Drosselung durch Azure beim Erreichen der DTU-Grenzwerte zu minimieren. Nachdem die Pipelineausführung abgeschlossen ist, ändern Sie die Größe der Datenbanken wieder auf die normale Ausführungsrate.

Azure Synapse Analytics-Senken

Stellen Sie beim Schreiben in Azure Synapse Analytics sicher, dass " Staging aktivieren " auf "true" festgelegt ist. Dadurch kann der Dienst mithilfe des SQL COPY-Befehls schreiben, wodurch die Daten effektiv in Massen geladen werden. Bei Verwendung von Staging müssen Sie auf ein Azure Data Lake Storage Gen2- oder Azure Blob Storage-Konto für das Staging der Daten verweisen.

Abgesehen von Staging gelten die gleichen bewährten Methoden für Azure Synapse Analytics als Azure SQL-Datenbank.

Dateibasierte Senken

Während Datenflüsse verschiedene Dateitypen unterstützen, wird das Spark-native Parkettformat für optimale Lese- und Schreibzeiten empfohlen.

Wenn die Daten gleichmäßig verteilt werden, ist die aktuelle Partitionierung die schnellste Partitionierungsoption zum Schreiben von Dateien.

Dateinamenoptionen

Beim Schreiben von Dateien haben Sie eine Auswahl an Benennungsoptionen, die jeweils auswirkungen auf die Leistung haben.

Wenn Sie die Standardoption auswählen, wird am schnellsten geschrieben. Jede Partition entspricht einer Datei mit dem Spark-Standardnamen. Dies ist nützlich, wenn Sie einfach aus dem Ordner der Daten lesen.

Durch Festlegen eines Namensmusters wird jede Partitionsdatei in einen benutzerfreundlicheren Namen umbenannt. Dieser Vorgang erfolgt nach dem Schreiben und ist etwas langsamer als die Auswahl des Standardwerts.

Pro Partition können Sie jede einzelne Partition manuell benennen.

Wenn eine Spalte Ihrer gewünschten Daten-Ausgabe entspricht, können Sie Namensdatei als Spaltendaten verwenden. Dadurch werden die Daten neu angeordnet und können sich auf die Leistung auswirken, wenn die Spalten nicht gleichmäßig verteilt werden.

Wenn eine Spalte der Erstellung von Ordnernamen entspricht, wählen Sie "Name"-Ordner als Spaltendaten aus.

Ausgabe in einzelne Datei kombiniert alle Daten in einer einzigen Partition. Dies führt zu langen Schreibzeiten, insbesondere für große Datasets. Diese Option wird abgeraten, es sei denn, es gibt einen expliziten geschäftlichen Grund, sie zu verwenden.

Azure Cosmos DB-Senken

Wenn Sie in Azure Cosmos DB schreiben, kann das Ändern des Durchsatzes und der Batchgröße während der Ausführung des Datenflusses die Leistung verbessern. Diese Änderungen werden nur während der Ausführung der Datenflussaktivität wirksam und kehren nach abschluss wieder zu den ursprünglichen Sammlungseinstellungen zurück.

Batchgröße: In der Regel reicht die Standardbatchgröße aus. Um diesen Wert weiter zu optimieren, berechnen Sie die grobe Objektgröße Ihrer Daten, und stellen Sie sicher, dass die Objektgröße * Batchgröße kleiner als 2 MB ist. Wenn dies der Grund ist, können Sie die Batchgröße erhöhen, um einen besseren Durchsatz zu erzielen.

Durchsatz: Legen Sie hier eine Einstellung für einen höheren Durchsatz fest, damit Dokumente schneller in Azure Cosmos DB schreiben können. Beachten Sie die höheren RU-Kosten bei einer höheren Durchsatzeinstellung.

Write Throughput Budget (Schreibdurchsatz): Verwenden Sie einen Wert, der kleiner als die Gesamtanzahl der RUs pro Minute ist. Wenn Sie über einen Datenfluss mit einer hohen Anzahl von Spark-Partitionen verfügen, ermöglicht das Festlegen eines Budgetdurchsatzes mehr Balance zwischen diesen Partitionen.

Verwandte Inhalte

- Übersicht über die Datenflussleistung

- Optimieren von Quellen

- Optimieren von Transformationen

- Verwenden von Datenflüssen in Pipelines

Weitere Artikel zum Datenfluss finden Sie in Bezug auf die Leistung: