Bemærk

Adgang til denne side kræver godkendelse. Du kan prøve at logge på eller ændre mapper.

Adgang til denne side kræver godkendelse. Du kan prøve at ændre mapper.

Microsoft Fabric-miljøer giver fleksibel konfiguration til at køre Spark-jobs. Biblioteker leverer genanvendelig kode til notebooks og Spark-jobdefinitioner. Ud over indbyggede biblioteker, der følger med hver Spark-runtime, kan du installere offentlige og brugerdefinerede biblioteker i Fabric-miljøer.

Bemærk

Navigér til det arbejdsområde, hvor dit miljø er placeret, vælg dit miljø, og biblioteksadministrationsmuligheder findes i venstre navigationspanel. Hvis du ikke har oprettet et miljø, se Create, configur og brug et miljø i Fabric.

Indbyggede biblioteker

I Fabric leveres hver runtime-version forudindlæst med et kurateret sæt indbyggede biblioteker, der er optimeret til ydeevne, kompatibilitet og sikkerhed på tværs af Python, R, Java og Scala. Siden med indbyggede biblioteker i miljøet lader dig browse og søge i disse forudinstallerede biblioteker baseret på den valgte runtime.

Disse biblioteker er installeret som standard i alle miljøer og kan ikke ændres. De vil være tilgængelige, hvis du kører din notebook eller Spark-jobdefinition i dette miljø.

For at se listen over forudinstallerede pakker og deres versioner for hver runtime, se Apache Spark runtimes i Fabric.

Bemærk

Per-notesbogsmetoder som notebook Resources-mappen og inline installationskommandoer (for eksempel %pip install eller %conda install i en kodecelle) er manuelle, session-scoped eller notebook-scoped og påvirkes ikke af miljøpublicering. Brug dem til hurtige, enkeltstående bibliotekstilføjelser under interaktiv udvikling.

Vigtige oplysninger

Fabric understøtter forskellige måder at håndtere pakker på. For flere muligheder og bedste praksis, se Manage Apache Spark-biblioteker i Fabric. Hvis dit arbejdsområde bruger netværksfunktioner som Workspace outbound access protection eller Managed VNets, blokeres adgang til offentlige repositories som PyPI. For vejledning, se Administrer biblioteker med begrænset netværksadgang i Fabric. Hvis de indbyggede biblioteksversioner ikke opfylder dine behov, kan du tilsidesætte dem ved at angive den ønskede version i sektionen for eksterne arkiver eller ved at uploade dine egne brugerdefinerede pakker.

Eksterne arkiver

Du kan tilføje biblioteker fra offentlige repositories som PyPI, Conda og Maven, eller fra private repositories. Kilde- og publiceringsmulighederne varierer afhængigt af typen af repository. Når du tilføjer et bibliotek, vælger du en publiceringstilstand (Fuld eller Hurtig). For detaljer om, hvordan hver tilstand fungerer, se Vælg publicer-tilstand for biblioteker.

Tilføj et bibliotek fra et offentligt Python-repository

Offentlige repositories lader dig installere pakker fra PyPI eller Conda.

I fanen Eksterne repositories vælger du Tilføj bibliotek.

Vælg Tilføj bibliotek fra offentligt arkiv.

Vælg kilden (PyPI eller Conda).

Indtast bibliotekets navn i søgefeltet. Mens du skriver, foreslår søgefeltet populære biblioteker, men listen er begrænset. Hvis du ikke kan se dit bibliotek, så indtast dets fulde navn.

Hvis bibliotekets navn findes, ser du de tilgængelige versioner.

Vælg versionen og gem og udgiv derefter dit miljø.

Tilføj bibliotek fra Maven

Fabric understøtter installation af biblioteker direkte fra Maven-repositorier. For at gøre dette opretter du en POM-fil , der viser de Maven-afhængigheder, du vil installere, og uploader den til Environment.

I fanen Eksterne repositories skal du vælge Importer pom.xml.

Vælg pom.xml-filen fra din lokale mappe.

Bemærk

- Import af pom.xml understøttes kun i Spark 4.0 og nyere.

- Import af pom.xml understøttes kun i fuld tilstand. I denne tilstand udfører Fabric afhængighedsløsning og konfliktdetektion for Maven-pakker. Hvis et bibliotek er inkompatibelt med runtime, vil du se en fejl efter udgivelsen.

- Import af pom.xml understøttes ikke i arbejdsområder med Outbound Access Protection aktiveret. I disse arbejdsområder downloader du de nødvendige biblioteker fra Maven og uploader dem som brugerdefinerede biblioteker i stedet.

Tilføj et bibliotek fra et privat repository

Private repositories lader dig installere pakker med pip eller conda.

I fanen Eksterne repositories vælger du Tilføj bibliotek.

Vælg Tilføj bibliotek fra privat repository.

Vælg kilden (pip eller conda).

Indtast bibliotekets navn og version. Sørg for at indtaste bibliotekets navn og version korrekt, for det understøttes ikke at søge i biblioteker i private repositories, mens du skriver. Forkert pakkeinformation får udgivelsen til at fejle.

Tilføj biblioteker fra et Azure Artifact Feed

Azure Artifact Feeds kan scopes til enten et projekt (privat) eller en organisation (offentlig). Fabric understøtter begge teleskoper. Uanset feedets synlighed i Azure DevOps, forbinder Fabric altid via en autentificeret Data Factory-forbindelse, så du skal oprette en forbindelse selv til offentlige feeds.

Bemærk

Installation af biblioteker fra Azure Artifact Feed understøttes i Spark 3.5. Det understøttes ikke i arbejdsområder med Private Link eller outbound access protection aktiveret.

Opret en forbindelse til dit Azure Artifact Feed

Miljøet gemmer ikke legitimationsoplysninger direkte. I stedet opretter du en forbindelse via Data Factory Connector og refererer til den efter forbindelses-ID i en YML-fil. Lær mere om Azure Artifact Feed.

Vælg tandhjulsikonet Indstillinger i øverste højre hjørne af Fabric-portalen, og vælg derefter Administrer forbindelser og gateways.

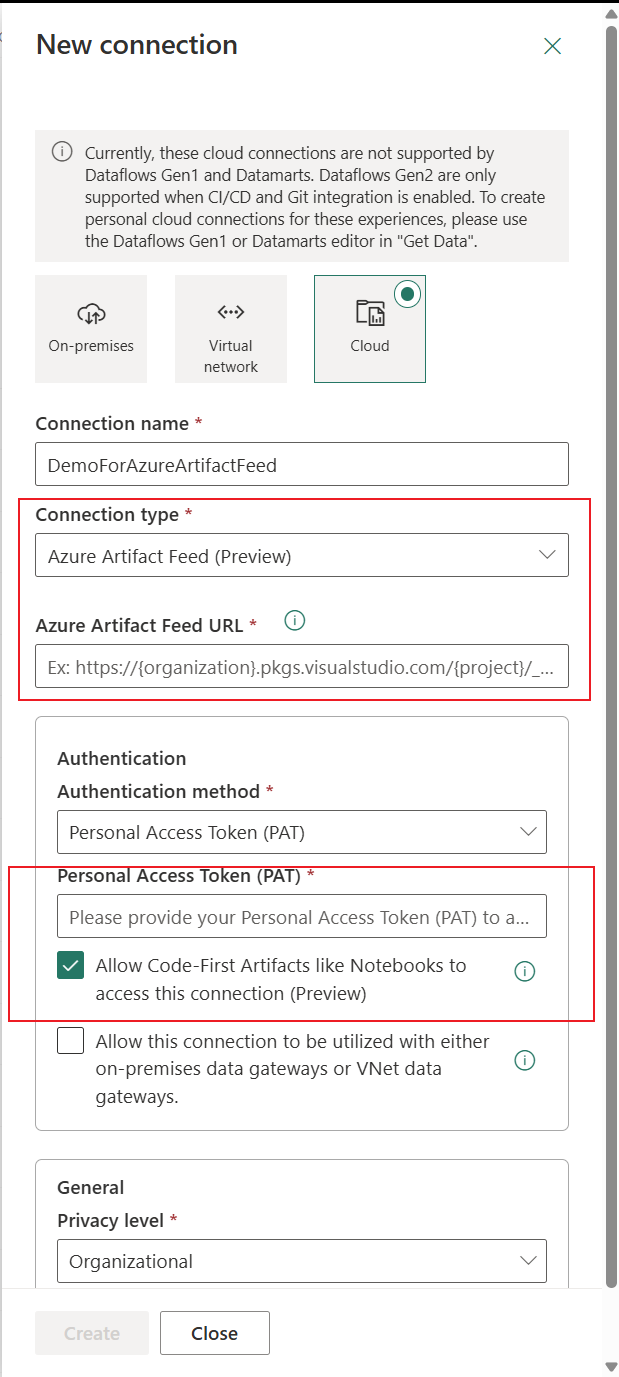

Opret en ny forbindelse. Vælg + Ny og vælg derefter Cloud som type og vælg Azure Artifact Feed (Preview) som forbindelsestype.

Indtast feed-URL'en og en personlig adgangstoken (PAT) med Packaging > Read-scope .

Vælg Tillad Code-First artefakter som notesbøger for at få adgang til denne forbindelse (Forhåndsvisning).

Vælg Opret for at gemme forbindelsen. Du burde kunne se det i forbindelseslisten.

Optag forbindelses-ID'et efter oprettelsen. Du skal bruge det i næste trin.

Forbered og upload en YML-fil

Opret en YML-fil, der lister de pakker, du vil installere, og refererer til forbindelses-ID'et i stedet for feed-URL'en og legitimationsoplysninger. Fabric bruger forbindelses-ID'et til at autentificere og trække pakker fra dit feed ved publicering.

En standard pip-konfiguration refererer direkte til feed-URL'en og legitimationsoplysninger:

dependencies:

- pip:

- fuzzywuzzy==0.18.0

- wordcloud==1.9.4

- --index-url <URL_TO_THE_AZURE_ARTIFACT_FEED_WITH_AUTH>

For Fabric erstatter du URL'en med det forbindelses-ID, du tidligere registrerede:

dependencies:

- pip:

- fuzzywuzzy==0.18.0

- wordcloud==1.9.4

- --index-url <YOUR_CONNECTION_ID>

Upload YML-filen direkte til miljøet, eller skift til YML-editorvisningen og indsæt indholdet. Når du publicerer miljøet, læser Fabric pakkerne fra dit feed og lagrer dem. Hvis du opdaterer pakker i dit Azure Artifact Feed, genudgiver miljøet for at hente de nyeste versioner.

Bemærk

- I Listevisningen kan du tilføje, fjerne eller redigere biblioteker fra eksisterende feedforbindelser. For at tilføje, fjerne eller redigere selve en feedforbindelse, skift til YML-editorvisningen og opdater YML-filen direkte.

- Du kan specificere flere feeds i YML-filen. Fabric gennemsøger dem i den angivne rækkefølge, indtil pakken findes. Offentlige arkiver som PyPI og Conda søges automatisk sidst, selvom de ikke er inkluderet i YML-filen.

- Hvis en pakke i YML-filen ikke kan findes i nogen af de listede feeds, fejler publiceringen. Dobbelttjek pakkenavnet og versionen før udgivelse.

Administrer eksterne biblioteker

Når du har tilføjet eksterne biblioteker, kan du administrere dem fra sektionen Eksterne repositories .

- Filter – Brug et pakkenavn som nøgleord til at filtrere listen over eksterne biblioteker.

- Opdater – Vælg et bibliotek for at opdatere dets navn, version eller kildetype i Listevisning. I YML-editorvisningen kan du også opdatere Azure Artifact Feed-forbindelses-ID.

- Slet – Hold musen over en biblioteksrække for at se Slet-muligheden , eller vælg flere biblioteker og vælg derefter Slet. Du kan også fjerne biblioteker ved at bruge YML-editorvisningen.

- View dependencies – Hold musen over et offentligt repository-bibliotek og vælg View dependencies for at hente dets dependency tree. Afhængighedsinformation er ikke tilgængelig for private biblioteker eller biblioteker fra et Azure Artifact Feed.

-

Eksporter til .yml – Eksporter hele listen over eksterne biblioteker til en

.ymlfil og download den til din lokale mappe.

Brugerdefinerede biblioteker

Brugerdefinerede biblioteker refererer til kode, der er oprettet af dig eller din organisation. Fabric understøtter brugerdefinerede biblioteksfiler i .whl, .py, .jar og .tar.gz formater. Som med eksterne biblioteker vælger du en publiceringstilstand (fuld eller hurtig), når du uploader brugerdefinerede pakker. For detaljer, se Vælg publiceringstilstand for biblioteker.

Bemærk

Fabric understøtter kun .tar.gz filer til R-sproget. Brug filformatet .whl og .py til Python sprog.

Brug Upload- og Download-knapperne på siden Brugerdefinerede biblioteker for at tilføje biblioteker fra din lokale mappe eller downloade dem lokalt.

For at slette et bibliotek, hold musen over dets række og vælg skraldekurvsikonet, eller vælg flere biblioteker og vælg derefter Slet.

Vælg publiceringstilstand for biblioteker

Når du tilføjer eksterne eller brugerdefinerede biblioteker, vælger du en publiceringstilstand. Full mode er tilgængelig for alle bibliotekskilder og arbejdsbelastningstyper. Quick mode er tilgængelig for offentlige arkiver og de fleste brugerdefinerede biblioteksformater, men kun når man kører notebooks.

Følgende tabel viser, hvilken publiceringstilstand hver bibliotekskilde understøtter.

| Bibliotekets kilde | Full mode | Quick mode |

|---|---|---|

| Offentligt arkiv (PyPI/Conda) | Ja | Ja |

| Privat repository (pip/conda) | Ja | Nej |

| Azure Artifact Feed | Ja | Nej |

Brugerdefineret .whl, .py, .tar.gz |

Ja | Ja |

Skik .jar |

Ja | Nej |

Vælg den rette tilstand til dine behov

Brug afhængighedskompleksitet og arbejdsbelastningstype til at afgøre, hvilken tilstand der passer til.

- Full mode løser afhængigheder, validerer kompatibilitet og skaber et stabilt bibliotekssnapshot under publicering. Det snapshot bliver udsendt, når en ny session starter. Bedst til større afhængighedssæt (for eksempel mere end 10 pakker), produktionsarbejdsbelastninger og pipelines. Publicering tager typisk 3 til 6 minutter; Sessionsopstart tilføjer 1 til 3 minutter til afhængighedsudrulning, afhængigt af afhængighedsstørrelsen. For at opretholde et stabilt snapshot og opnå cirka 5-sekunders sessionsstart, brug Full mode sammen med en brugerdefineret live pool.

- Hurtig tilstand springer afhængighedsbehandling over under udgivelse og installerer pakker ved notebook-sessionens opstart i stedet. Bedst til lettere afhængighedssæt, hurtig iteration og tidlige eksperimenter. Publiceren er færdig på cirka 5 sekunder; Bibliotekets installation sker ved sessionens start.

Du kan blande modes under udviklingen. Et almindeligt mønster er at iterere i quick mode og derefter flytte validerede afhængigheder til full mode for et stabilt produktionssnapshot. Du kan også beholde et eksisterende fuldtilstandssnapshot uændret og lægge nye testpakker i quick mode — full mode-snapshotet deployeres først, og derefter installeres quick mode-pakkerne ovenpå.

Tilstandsbegrænsninger og adfærd

Husk disse begrænsninger, når du arbejder med publiceringsmetoder.

- Quick mode fungerer kun med notesbøger, ikke Spark-jobdefinitioner.

- For at flytte et brugerdefineret bibliotek mellem tilstande, download filen, fjern den fra den nuværende tilstand og upload den derefter til måltilstanden. Direkte overførsler mellem tilstande understøttes ikke.

- Installationslogs vises ikke i notesbogen. Brug Overvågning (niveau 2) til at følge fremskridt og fejlfinde.

- Når begge tilstande indeholder pakker, gælder det fulde øjebliksbillede først. Quick mode-pakker installeres ovenpå og overskriver enhver fuld mode-pakke med samme navn.

- Når der findes dubletter pakker på tværs af tilstande, tilsidesætter Quick mode-versioner kun Full mode-versioner for den aktuelle notebook-session. Når du starter en ny session, geninstalleres Full mode snapshot først, og derefter installeres Quick mode-pakkerne ovenpå.

- Quick mode-pakker installeres, når den første kodecelle for det pågældende sprog kører. For eksempel installeres Python-pakker, når den første Python-celle kører, og R-pakker installeres, når den første R-celle kører.